New Feature Pipeline (Mars 2026) : Entretien Lakehouse et Refresh SQL Endpoint

1.Introduction

Jusqu’à présent, l’entretien des tables Delta Lake dans Fabric imposait l’écriture de notebooks PySpark pour exécuter OPTIMIZE, VACUUM ou Z-ORDER. De même, la synchronisation des métadonnées du SQL Analytics Endpoint nécessitait des appels API manuels pour garantir la fraîcheur des données. Depuis mars 2026, Microsoft déploie deux activités natives qui permettent de gérer ces opérations directement depuis l’interface graphique des pipelines, sans code.

Cet article présente ces nouveautés : Lakehouse Maintenance pour l’entretien automatisé, Refresh SQL Endpoint pour la synchronisation des métadonnées, et une troisième fonctionnalité de Notifications natives qui simplifie la surveillance des pipelines .

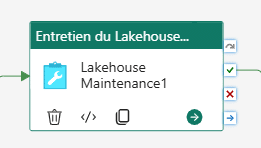

2.Entretien du Lakehouse (Lakehouse Maintenance)

2.1 Présentation

L’activité Lakehouse Maintenance permet d’exécuter des opérations de maintenance Delta Lake directement depuis l’interface graphique des pipelines, elle élimine le besoin d’écrire des notebooks PySpark pour les tâches courantes d’optimisation.

2.2 Les opérations disponibles

OPTIMIZE : Compacte les petits fichiers Parquet en fichiers plus volumineux (jusqu’à 1 GB par défaut). Delta Lake génère de nombreux petits fichiers lors des écritures incrémentales, ce qui ralentit les requêtes. OPTIMIZE fusionne ces fichiers pour améliorer les performances de lecture.

V-Order : Active la compression optimisée spécifique à Microsoft Fabric. V-Order réorganise les données en colonnes pour maximiser la compression et accélérer les lectures en mode Direct Lake dans Power BI. Cette option est particulièrement recommandée si vos tables alimentent des semantic models.

Z-Order : Trie physiquement les données selon une ou plusieurs colonnes pour améliorer les performances des filtres. Si vous filtrez souvent par date ou region, un Z-Order sur ces colonnes réduit le nombre de fichiers à scanner lors des requêtes.

VACUUM — Supprime les anciens fichiers obsolètes en respectant une période de rétention (par défaut 7 jours, soit 7:00:00:00). Delta Lake conserve les anciennes versions pour le Time Travel, mais ces fichiers finissent par occuper beaucoup d’espace. VACUUM nettoie les versions au-delà de la rétention configurée.

2.3 Configuration

Ajouter l’activité : Sélectionnez Lakehouse Maintenance depuis la palette d’activités du pipeline.

L’activité doit se positionner après toutes les écritures de données et transformations, mais avant la synchronisation SQL Endpoint et le refresh Power BI.

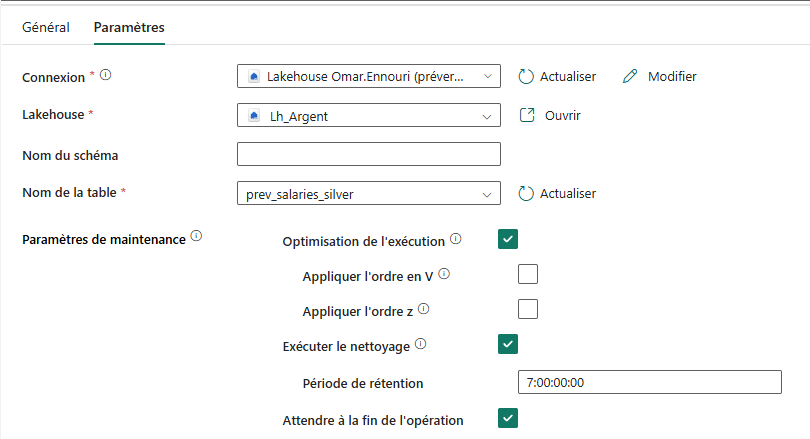

Sélectionner la cible :

- Workspace : Workspace contenant le lakehouse

- Lakehouse : Nom du lakehouse (ex:

Lh_Sales) - Table : Table Delta à maintenir (ex:

transactions)

Configurer les opérations :

- OPTIMIZE : Recommandé systématiquement

- V-Order : Si la table alimente un semantic model Direct Lake

- Z-Order : Colonnes de filtrage fréquentes (ex:

date, region) - VACUUM : Rétention au format

HH:MM:SS(ex:7:00:00:00)

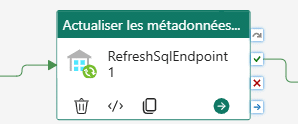

3.Actualiser les métadonnées SQL (Refresh SQL Endpoint)

3.1 Présentation

Chaque lakehouse dans Fabric expose automatiquement un SQL Analytics Endpoint qui permet d’interroger les tables Delta via T-SQL. Cependant, les métadonnées de cet endpoint peuvent être désynchronisées avec les données réelles/

Cette désynchronisation crée un risque : un refresh Power BI déclenché immédiatement après l’écriture de données peut ne pas voir les nouvelles lignes, produisant des rapports incomplets.

3.2 Configuration

Ajouter l’activité : Sélectionnez Refresh SQL Endpoint depuis la palette.

L’activité Refresh SQL Endpoint se positionne après toutes les écritures et la maintenance, juste avant le refresh Power BI.

Sélectionner la cible :

- Workspace : Workspace contenant le point de terminaison SQL

- ID de point de terminaison SQL

- Choisir ou crée une connexion

4.Notifications de Défaillance Natives

4.1 Le problème de surveillance

Avant cette fonctionnalité, recevoir des notifications d’échec nécessitait soit d’ajouter manuellement des activités Outlook/Teams dans la branche « En cas d’échec » de chaque pipeline, soit de configurer un flux Power Automate pour surveiller les exécutions. Ces approches étaient chronophages et difficiles à maintenir à l’échelle.

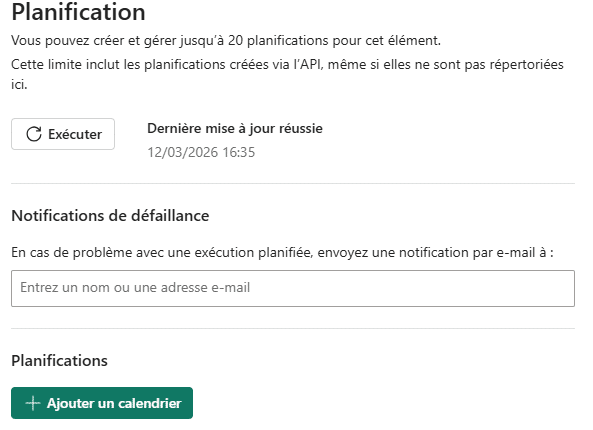

4.2 La solution native

Microsoft a intégré un champ email de notification directement dans les paramètres des pipelines et notebooks. Lorsqu’une exécution échoue, les adresses configurées reçoivent automatiquement un email contenant :

- Le nom du pipeline ou notebook en échec

- L’activité spécifique qui a échoué

- L’ID d’activité pour le debugging

- Le message d’erreur complet

4.3 Configuration

- Ouvrez les paramètres de votre pipeline ou notebook

- Ajoutez une ou plusieurs adresses dans « Notifications de défaillance »

- Enregistrez

Laisser un commentaire

Il n'y a pas de commentaires pour le moment. Soyez le premier à participer !