Ingérer des données externes dans Microsoft Fabric (exemples : Dynamics 365, SAP, Talend)

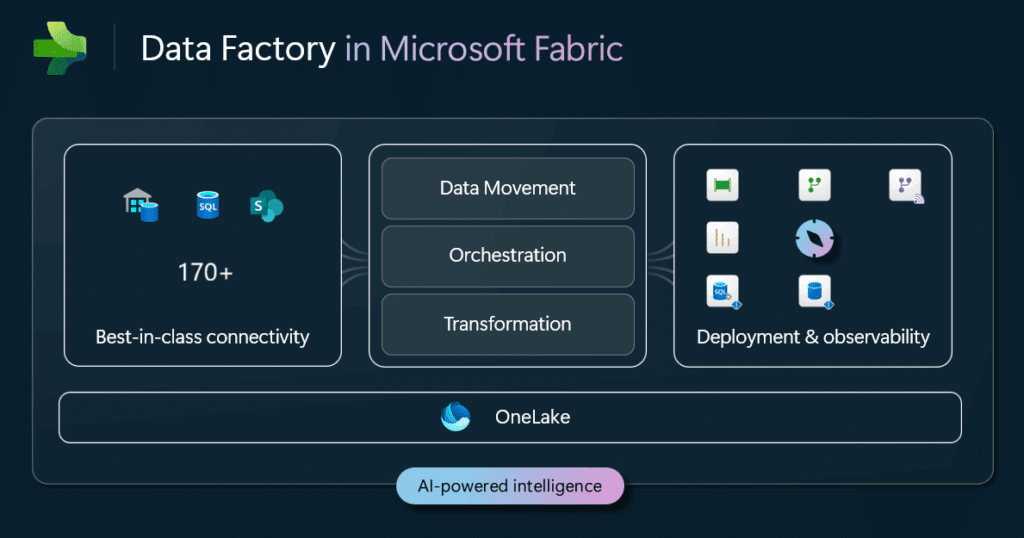

Pourquoi connecter des outils externes ?

Dans la plupart des entreprises, une partie des données se trouve en dehors de Fabric — par exemple dans un CRM (Dynamics 365), un ERP (SAP) ou des chaînes ETL existantes (Talend). L’objectif est de rapatrier et centraliser ces données dans OneLake / Lakehouse ou dans le Warehouse afin de les analyser (Power BI, SQL, notebooks) et de les gouverner au même endroit.

Pour cela, Data Factory dans Fabric met à disposition des connecteurs et des pipelines prêts à l’emploi, facilitant l’ingestion, la synchronisation et l’orchestration de bout en bout.

De la source à Fabric : exemples avec Dynamics 365, SAP et Talend

Découvrez, à travers Dynamics 365, SAP et Talend, les différentes voies pour acheminer vos données vers Microsoft Fabric et les exploiter de façon unifiée.

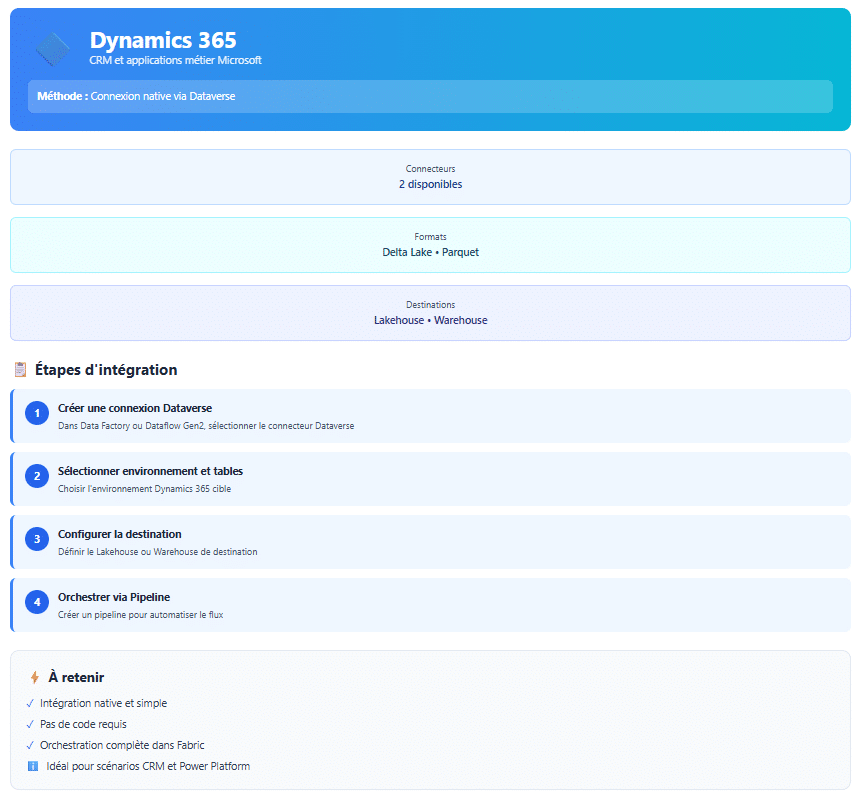

1) Dynamics 365 → Fabric :

La voie la plus directe consiste à utiliser le connecteur Dataverse dans Data Factory ou Dataflow Gen2. On sélectionne l’environnement et les tables, puis on charge en Delta/Parquet vers un Lakehouse ou un Warehouse. Cette approche convient parfaitement aux scénarios CRM (clients, opportunités, activités) et s’orchestre facilement via des pipelines.

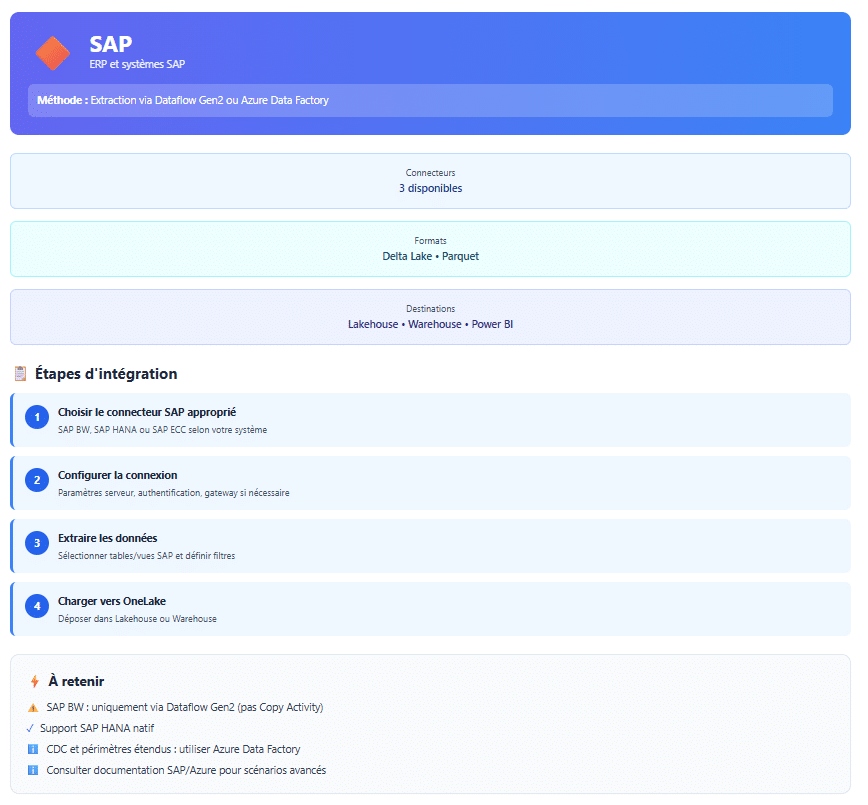

2) SAP → Fabric :

Fabric propose plusieurs connecteurs, notamment SAP BW Application Server et SAP HANA (via Dataflow Gen2). Les données SAP sont extraites puis déposées dans OneLake pour exploitation dans Power BI ou SQL. À noter : SAP BW n’est pas encore pris en charge par l’activité Copy des pipelines ; il faut donc passer par Dataflow Gen2 pour ce connecteur. Pour des besoins avancés (CDC, périmètres étendus), compléter avec les solutions SAP/Azure Data Factory documentées.

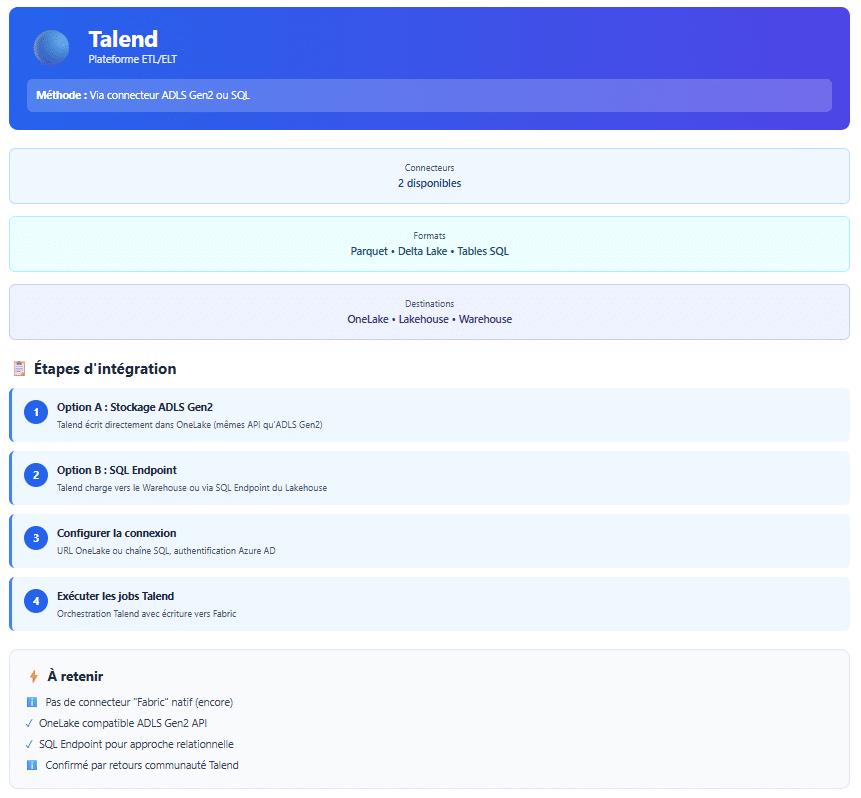

3) Talend → Fabric :

Il n’existe pas (encore) de connecteur « Fabric » natif dans Talend, mais deux options simples fonctionnent :

- Stockage compatible ADLS Gen2 : Talend peut écrire directement dans OneLake (mêmes API) en Parquet/Delta.

- SQL Endpoint : Talend peut charger vers le Warehouse ou lire/écrire via l’endpoint SQL du Lakehouse.

Des retours de la communauté confirment ces approches ; côté Talend, on s’appuie sur le connecteur ADLS Gen2.

Laisser un commentaire

Il n'y a pas de commentaires pour le moment. Soyez le premier à participer !